El recnac es autónomo. En complejidad es comparable a una bacteria. No depende de otras células para su supervivencia. Una vez dentro de un cuerpo no sigue las órdenes que obedecen las otras células de ese cuerpo. El recnac es genéticamente diferente de las otras células del cuerpo donde reside. El recnac puede crecer donde, cuando y como prefiera.

Al dar estas características parece que estuviésemos describiendo el recnac como una especie invasora, un parásito. Sólo nos faltaría saber que el recnac puede infectar otros cuerpos para colocarle la etiqueta de parásito; y aquí es donde la diferencia con el cáncer se debería hacer patente, ya que asumimos que el cáncer no es contagioso, lo que es cierto para un porcentaje tremendamente alto de tipos de cáncer. Pero se conocen tres cánceres transmisibles: el tumor facial de los demonios de Tasmania, el tumor venéreo transmisible canino, en ambos casos basta una sola célula cancerosa completa, y el cáncer transmisible de los hamsters. Visto así, recnac y cáncer, el primero ficticio, el segundo real, tienen las mismas características, las de un parásito.

Un paciente de cáncer puede percibir su tumor como un parásito que se reproduce y toma el control de su cuerpo. Pero para el equipo de investigadores de la Universidad de California en Berkeley (Estados Unidos) encabezado por Peter Duesberg esta imagen es algo más que una metáfora. Según un artículo [1] que publican en Cell Cycle los tumores cancerosos son organismos parasitarios; cada uno es una nueva especie que, como la mayoría de los parásitos, depende de su huésped para su alimentación pero por lo demás funciona independientemente y, a menudo, en detrimento de su huésped. Dicho formalmente, la carcinogénesis (la generación de un cáncer) es simplemente una forma de especiación (la evolución de una nueva especie). Esta aproximación puede resultar útil a la hora de comprender el crecimiento del cáncer y sus metástasis.

La idea de que la formación del cáncer sea similar a la evolución de una nueva especie no es nueva. Ya en 1956 Julian Huxley hablaba de la consideración del tumor canceroso como una nueva especie biológica. Más recientemente Mark Vincent argumentaba en Evolution [2] que la carcinogénesis y la evolución clónica de las células cancerosas son eventos de especiación en sentido darwiniano estricto. La novedad del trabajo de Duesberg et al. estriba en su crítica a la teoría de la mutación y en la importancia del cariotipo. Pero vayamos por partes.

Los argumentos del equipo de investigadores parten de una propuesta, cuando menos, controvertida: afirman que la idea de que los tumores comienzan con un puñado de genes mutados haciendo que una célula tenga un crecimiento incontrolado es errónea (¡ojo!, que estas son palabras mayores). Los investigadores afirman que la carcinogénesis se iniciaría por una alteración de los cromosomas, lo que lleva a duplicaciones, eliminaciones, roturas y daños cromosómicos varios que alteran el equilibrio, no de unos cuantos genes, sino de decenas de miles. El resultado es una célula con características completamente nuevas, con un nuevo fenotipo.

La teoría de la mutación es la teoría imperante hoy día a la hora de enfrentarse al cáncer. Muchos de los fármacos que se emplean en el tratamiento se basan en la idea de bloquear estas mutaciones. Sin embargo, muy pocos cánceres se han curado usando fármacos dirigidos a estas dianas e, incluso si el fármaco ayuda al paciente a sobrevivir 6, 9 o más meses las células cancerosas terminan en muchas ocasiones encontrando una forma de seguir creciendo.

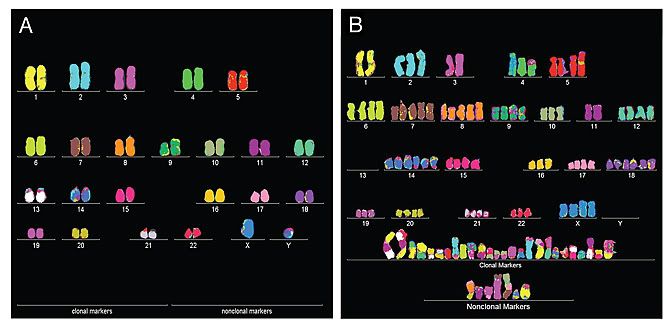

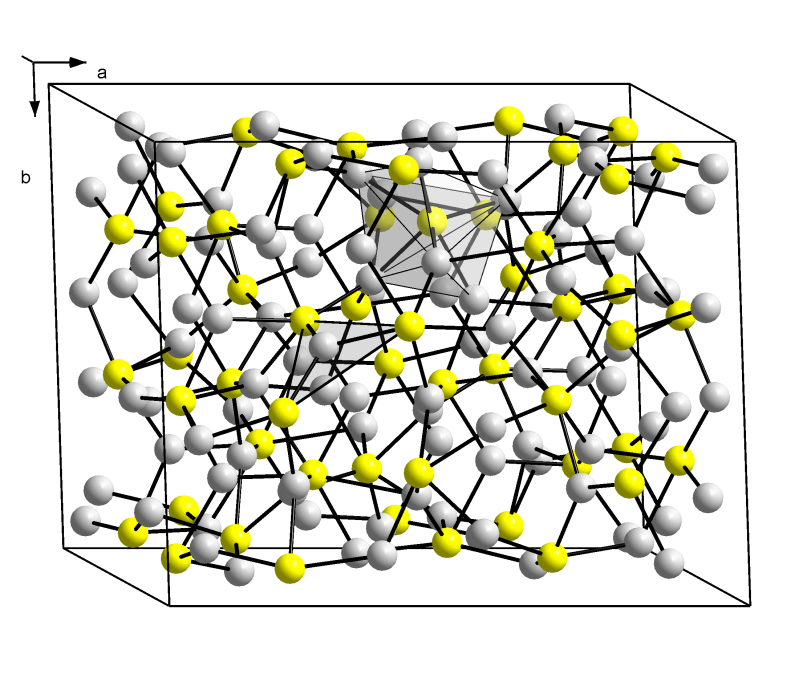

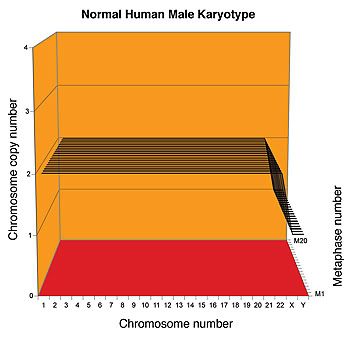

La alteración de los cromosomas, llamada aneuploidía, ya se sabe que causa problemas. El síndrome de Down, puede que el ejemplo más conocido, está causado por la existencia de una tercera copia del cromosoma 21, cuando los humanos tenemos 23 pares de cromosomas habitualmente [en la imagen, A]. Según el equipo de Duesberg todas las células cancerígenas son todas aneuploides [en la imagen , B]; lo que los proponentes de la teoría de la mutación consideran un efecto del cáncer, no la causa.

Una idea central en la teoría de Duesberg es que alguna mutación cromosómica inicial, quizás afectando al mecanismo que duplica o separa los cromosomas como preparación para la división celular, altera los cromosomas celulares, rompiendo algunos o haciendo copias extra de otros. Normalmente esto implica una sentencia de muerte para la célula, pero en algunos casos improbables, estos cromosomas alterados podrían seguir dividiéndose, perpetuando y agravando el daño. A lo largo de las décadas de vida de una persona , la continua división celular produciría muchas células inviables así como algunas capaces de dividirse autónomamente y ser el origen de un cáncer.

Asumida esta idea, el paso que dan Duesberg et al. parece lógico: el cáncer es una nueva especie porque aquellas células alteradas lo suficientemente viables como para continuar dividiéndose desarrollan patrones cromosómicos relativamente estables, los denominados cariotipos [en la imagen, cariotipos de una célula humana de varón normal, A, y cancerosa, B], distinto del patrón cromosómico del huésped. Si bien todos los organismos que se conocen hoy día tienen cariotipos estables, con todas las células conteniendo exactamente 2 ó 4 copias de cada cromosoma, los cánceres exhiben unos cariotipos más flexibles e impredecibles, que incluyen no sólo cromosomas intactos del huésped sino también cromosomas parciales, truncados y simples muñones.

Si los humanos cambiásemos nuestro cariotipo, el número y disposición de nuestros cromosomas, o moriríamos o no podríamos reproducirnos o, en muy raras ocasiones, nos convertiríamos en una especie distinta. Pero las células cancerosas simplemente se dividen produciendo copias de sí mismas. No tienen que ocuparse de buscar otra célula para reproducirse. De hecho, siempre y cuando los genes de la mitosis estén intactos una célula cancerosa puede sobrevivir con muchos cromosomas alterados y desequilibrados, como los que se encuentran en una célula aneuploide. El cariotipo cambia cuando una célula cancerosa se divide, ya que el estado de los cromosomas impide su copia perfecta, pero cambia dentro de ciertos límites, manteniéndose estable dentro de ellos.

|

| Cariografo de 20 células sanas de un varón humano. |

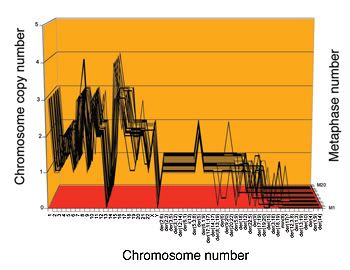

Duesberg y sus colegas han desarrollado una forma de expresar gráficamente el cariotipo, el cariografo. El cariografo permite visualizar la naturaleza aneuploide del cariotipo de la célula y su estabilidad a lo largo de numerosos cultivos celulares. Usando estos cariografos los investigadores han analizado varios cánceres, mostrando claramente que el cariotipo es sorprendentemente similar en todas las células de una línea cancerígena concreta, pero totalmente diferente de los cariotipos de otros cánceres y, lo que es más importante, diferente del mismo cáncer pero de otro paciente.

|

| Cariografo de 20 células HeLa |

Un ejemplo especialmente significativo son las células HeLa, quizás la línea de cáncer más famosa de la historia. Las células HeLa se obtuvieron en 1951 de un cáncer cervical que terminó matando a una joven afroamericana llamada Henrietta Lacks. La línea celular de 60 años de edad derivada de su cáncer tiene un cariotipo relativamente estable que la mantiene viva división tras división.

Según los autores, una vez que la célula ha traspasado la barrera de la autonomía es una nueva especie. Así las células HeLa habrían evolucionado en el laboratorio y son ahora probablemente más estables que cuando aparecieron la primera vez.

Los cariotipos de los cánceres se asemejan pues a los distintos cariotipos de las diferentes especies. Si bien los biólogos no han caracterizados los cariotipos de la mayoría de las especies, no se conocen dos especies que tengan el mismo número y disposición de los cromosomas, ni siquiera aquellas, como gorilas y humanos, que comparten el 99% de la carga genética.

Los investigadores afirman que esta teoría de la especiación explica la autonomía e inmortalidad del cáncer así como su cariotipo relativamente estable y flexible. También explicaría el largo período de latencia entre la aneuploidización y el cáncer propiamente dicho, dada la baja probabilidad de que evolucione un cariotipo autónomo.

Nota:

Peter Duesberg es un negacionista del SIDA y, por lo tanto, sus investigaciones últimamente están todas manchadas por esta posición. Pero, siguiendo la política de Scientific American, que nos parece correcta, hemos presentado su trabajo aquí porque pensamos que sus ideas sobre el cáncer, a cuyo conocimiento ha aportado avances significativos, constituyen una hipótesis objetivamente digna de consideración, sea finalmente correcta o no.

Referencias:

[1] Duesberg, P., Mandrioli, D., McCormack, A., & Nicholson, J. (2011). Is carcinogenesis a form of speciation? Cell Cycle, 10 (13), 2100-2114 DOI: 10.4161/cc.10.13.16352

[2] Vincent, M. (2009). THE ANIMAL WITHIN: CARCINOGENESIS AND THE CLONAL EVOLUTION OF CANCER CELLS ARE SPECIATION EVENTS SENSU STRICTO Evolution, 64 (4), 1173-1183 DOI: 10.1111/j.1558-5646.2009.00942.x

[2] Vincent, M. (2009). THE ANIMAL WITHIN: CARCINOGENESIS AND THE CLONAL EVOLUTION OF CANCER CELLS ARE SPECIATION EVENTS SENSU STRICTO Evolution, 64 (4), 1173-1183 DOI: 10.1111/j.1558-5646.2009.00942.x